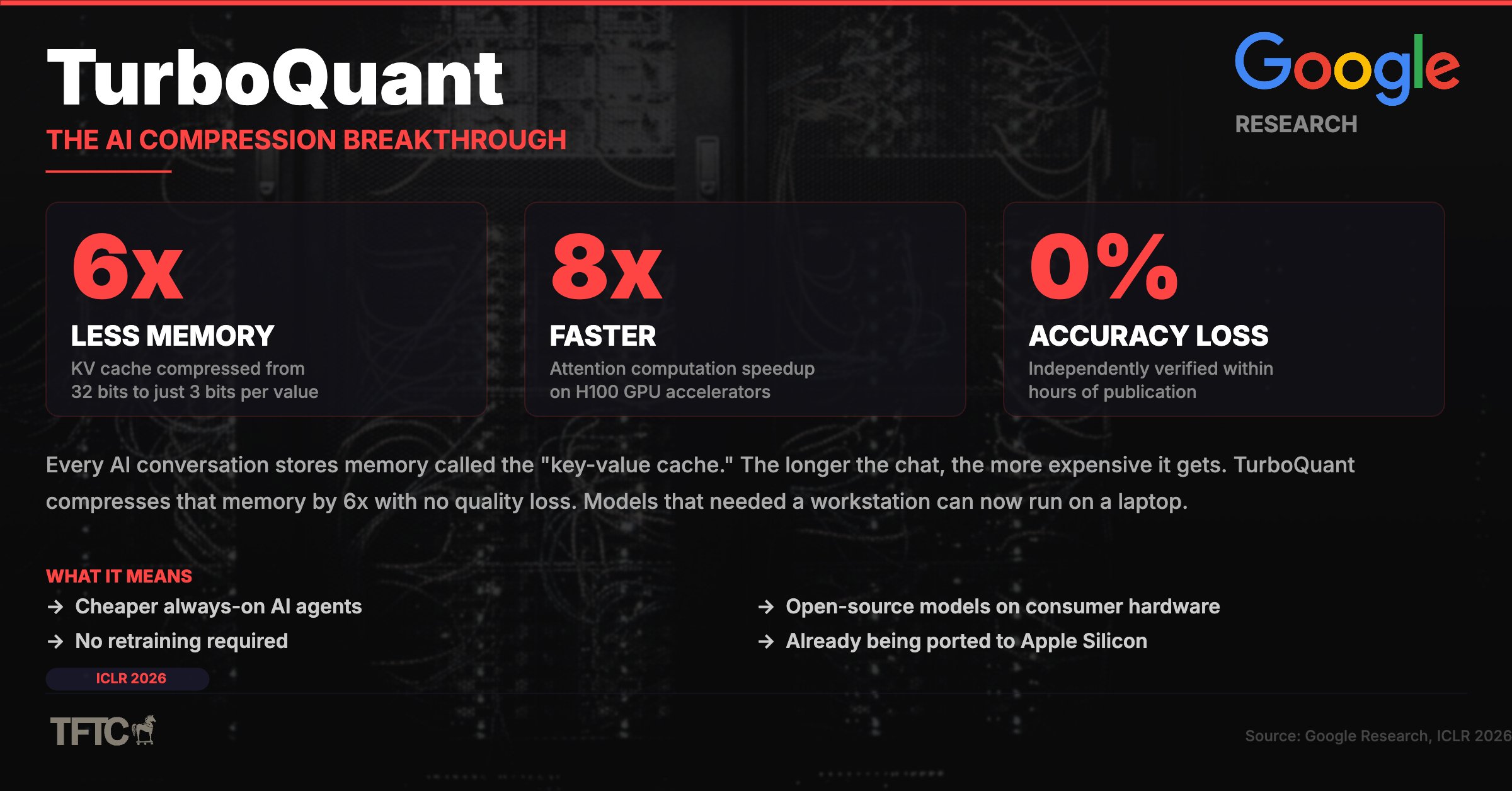

Google vừa thả một quả bom vào thị trường chip nhớ. Hôm qua, gã khổng lồ công nghệ công bố nghiên cứu TurboQuant, một thuật toán nén có khả năng giảm lượng bộ nhớ cần thiết để chạy các model ngôn ngữ lớn xuống 6 lần mà không mất độ chính xác.

Phản ứng từ thị trường tài chính đến gần như tức thì. Cổ phiếu của các nhà cung cấp chip nhớ và lưu trữ lớn đồng loạt lao dốc trong phiên giao dịch sáng thứ Tư: Micron Technology giảm 4%, Western Digital tụt 4,4%, Seagate Technology rớt 5,6%, và Sandisk chìm sâu 6,5%.

Để hiểu tại sao một bài nghiên cứu học thuật lại có thể gây ra cơn địa chấn như vậy, cần phải hiểu vấn đề mà TurboQuant đang giải quyết.

Mỗi khi bạn trò chuyện với ChatGPT hay bất kỳ AI nào, model phải nhớ mọi thứ bạn đã nói trong cuộc hội thoại. Bộ nhớ đó được gọi là "key-value cache" hay KV cache. Càng trò chuyện dài, bộ nhớ cache càng lớn, và chi phí vận hành càng đắt đỏ. Đây chính là nút thắt lớn nhất trong AI hiện nay.

Con số thực tế còn kinh hoàng hơn nhiều người tưởng. Một cuộc trò chuyện 128.000 từ trên một model lớn ngốn tới 40GB bộ nhớ GPU chỉ cho một người dùng duy nhất. Nhân con số đó lên hàng nghìn người dùng và bạn đang đốt hàng triệu USD chi phí tính toán để xử lý lại cùng một dữ liệu nhiều lần.

Đây chính là lý do tại sao toàn bộ ngành công nghiệp chip nhớ đã đặt cược tương lai của họ vào việc vấn đề này không bao giờ được giải quyết. Micron đã bán hết HBM memory đến hết năm 2026, SK Hynix ký hợp đồng cung cấp cho NVIDIA trước nhiều năm. Ngành dự báo nhu cầu HBM tăng 70% năm qua năm cho năm 2026.

Thuật toán làm thay đổi cả ngành phần cứng

TurboQuant phá vỡ hoàn toàn phương trình đó. Thuật toán này nén bộ nhớ cache xuống chỉ còn 3 bits mỗi giá trị, so với mức tiêu chuẩn ngành là 32 bits, đồng nghĩa với việc giảm gần 11 lần.

Trong khi đó, các phương pháp nén trước đây đều phải đánh đổi: nén bộ nhớ thì mất chất lượng. Các kỹ sư chấp nhận thỏa hiệp đó vì không có lựa chọn nào khác. TurboQuant xóa bỏ hoàn toàn sự đánh đổi này. Các nhà phát triển độc lập đã test trong vài giờ và nhận được kết quả khớp chính xác với output sử dụng bộ nhớ đầy đủ. Không có sự suy giảm chất lượng nào cả.

Cơ chế hoạt động của TurboQuant khá tinh vi nhưng có thể hiểu đơn giản như sau. Google lấy một danh sách dài các con số đại diện cho bộ nhớ của model và xoay nó một chút, giống như xoay một đống đồ vật để chúng xếp gọn hơn trong hộp. Điều này làm cho các con số dễ lưu trữ hơn ở dạng độ chính xác rất thấp, do đó mỗi con số sử dụng ít bits hơn nhiều trong khi vẫn giữ hầu hết các mẫu hữu ích.

Bước thứ hai là một quy trình làm sạch sửa chữa một phần biến dạng do nén mạnh đó gây ra, để model vẫn có thể tìm thấy thông tin quá khứ chính xác thay vì bị nhầm lẫn bởi phiên bản được lưu trữ thô hơn.

Nguy cơ đối với ngành chip nhớ

Điều đặc biệt nguy hiểm đối với ngành chip nhớ là TurboQuant không cần huấn luyện lại hay tinh chỉnh model. Nó có thể được cài đặt ngay vào các hệ thống AI hiện có mà không cần sửa đổi gì. Google đã test nó trên ba model AI lớn và năm benchmark khác nhau, kết quả đều khớp hoặc vượt trội.

Thuật toán này đã đang chạy bên trong Gemini, và các nhà phát triển đang chuyển nó sang Apple Silicon. Điều này có nghĩa là các model AI từng cần một workstation 10.000 USD giờ có thể chạy trên MacBook. Các tác nhân AI hoạt động liên tục trở nên rẻ hơn đáng kể để vận hành. Các model open-source quá lớn đối với phần cứng tiêu dùng đột nhiên trở nên khả thi.

Google cũng tuyên bố hiệu suất nhanh hơn tới 8 lần trên H100 cho một số thao tác chính, vì vậy đây không chỉ là về tiết kiệm bộ nhớ mà còn về di chuyển dữ liệu với ít ma sát hơn.

Mặc dù vậy, đợt bán tháo cổ phiếu các công ty chip nhớ dường như cho thấy phản ứng quá mức vì những thành công trong phòng thí nghiệm không tự động trở thành triển khai toàn ngành và nhu cầu AI vẫn đang chạm tới giới hạn cung cứng. Trong ngắn hạn, các cổ phiếu chip nhớ vẫn ổn vì hợp đồng đã ký, doanh thu đã khóa, không có gì phát nổ trong quý này.

Tuy nhiên, Google vừa chứng minh rằng nút thắt phần cứng đắt nhất trong AI có thể được hóa giải bằng phần mềm. Tuy vậy, thuật toán này sẽ không bao giờ thay thế được phần cứng của bạn, chúng chỉ khiến nó trở nên ít quan trọng hơn mà thôi. Và đó chính xác là điều Google vừa làm với ngành công nghiệp chip nhớ trị giá hàng tỷ USD.

Nguyễn Hải