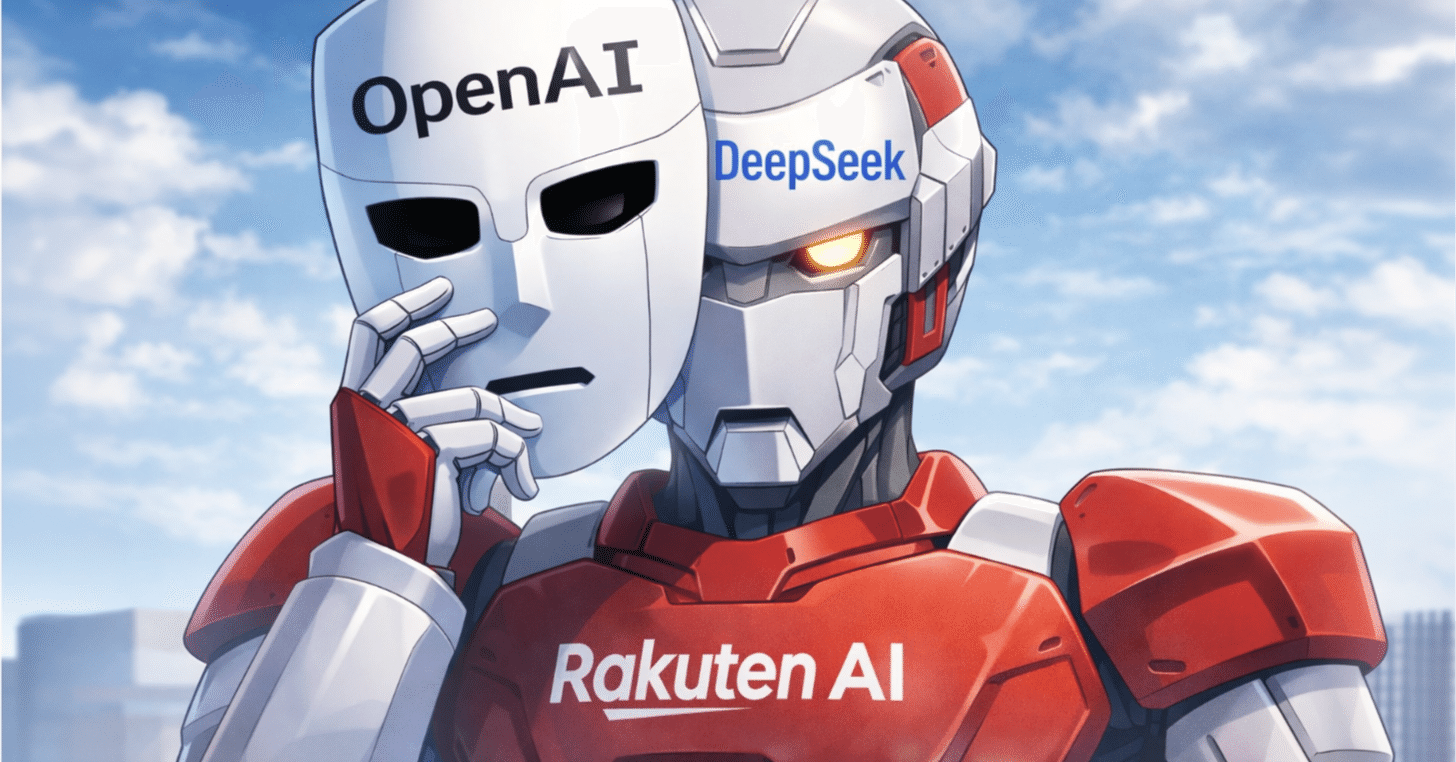

Rakuten vừa công bố mô hình ngôn ngữ lớn Rakuten AI 3.0 với quy mô khoảng 700 tỷ tham số, được giới thiệu là một trong những hệ thống AI mạnh nhất tại Nhật Bản. Cho dù được quảng bá như một niềm hy vọng của Nhật Bản trong cuộc đua AI, ngay sau khi ra mắt, cộng đồng mã nguồn mở phát hiện mô hình này thực chất được xây dựng dựa trên kiến trúc của DeepSeek V3 – một nền tảng AI phát triển tại Trung Quốc.

Cụ thể, trong các tệp cấu hình được công bố trên nền tảng Hugging Face, mô hình của Rakuten xuất hiện trực tiếp các tham chiếu đến “deepseek_v3”, cùng với các thông số kỹ thuật trùng khớp với DeepSeek V3, bao gồm kiến trúc Mixture-of-Experts (MoE) và quy mô khoảng 671 tỷ tham số, trong đó kích hoạt khoảng 37 tỷ tham số cho mỗi lần suy luận.

Điều này cho thấy Rakuten AI 3.0 nhiều khả năng không phải là một mô hình được phát triển hoàn toàn từ đầu, mà là kết quả của việc tinh chỉnh (fine-tune) dựa trên nền tảng có sẵn, với dữ liệu được tối ưu cho tiếng Nhật và các bối cảnh nội địa.

Trong thế giới mã nguồn mở, chuyện này thường không vấn đề gì, DeepSeek cũng phát hành công trình của họ theo giấy phép MIT. Tuy nhiên, điều đáng nói là trong thông cáo ra mắt, Rakuten không đề cập cụ thể đến DeepSeek, chỉ mô tả mô hình của mình là sự kết hợp từ “các thành tựu tốt nhất của cộng đồng mã nguồn mở”.

Cách diễn đạt này khiến nhiều người hiểu rằng đây là một sản phẩm mang tính “nội địa hóa hoàn toàn”, đặc biệt khi dự án có sự hỗ trợ từ chương trình GENIAC – sáng kiến thúc đẩy AI của Bộ Kinh tế, Thương mại và Công nghiệp Nhật Bản.

Tranh cãi gia tăng khi cộng đồng phát hiện tệp giấy phép MIT gốc của DeepSeek – vốn yêu cầu giữ lại thông tin tác giả – đã bị loại bỏ khỏi kho mã nguồn khi Rakuten phát hành mô hình. Sau khi bị chỉ ra, công ty được cho là đã bổ sung lại thông tin này dưới một mục “NOTICE”, nhưng không giải thích rõ ràng về sự thay đổi ban đầu.

Về mặt kỹ thuật, Rakuten AI 3.0 vẫn được đánh giá là một mô hình có hiệu năng cao trong các bài kiểm tra liên quan đến tiếng Nhật, bao gồm hiểu biết văn hóa, suy luận và toán học. Tuy nhiên, các so sánh hiệu năng chủ yếu được thực hiện với những mô hình nhỏ hơn đáng kể, khiến kết quả trở nên khó đánh giá toàn diện.

Việc sử dụng các mô hình mã nguồn mở làm nền tảng không phải là điều bất thường trong ngành AI. Trên thực tế, nhiều công ty đã phát triển sản phẩm dựa trên các kiến trúc như DeepSeek hoặc Qwen, sau đó tinh chỉnh để phù hợp với thị trường mục tiêu. Điểm khác biệt trong trường hợp của Rakuten nằm ở cách công ty truyền thông về nguồn gốc công nghệ.

Sự việc cũng diễn ra trong bối cảnh Nhật Bản đang nỗ lực xây dựng năng lực AI nội địa nhằm giảm phụ thuộc vào các công ty công nghệ nước ngoài. Dự án GENIAC, nơi Rakuten là một trong những đơn vị tham gia, được kỳ vọng sẽ tạo ra các “nhà vô địch quốc gia” trong lĩnh vực này.

Tuy nhiên, việc một mô hình được quảng bá là đại diện cho năng lực trong nước lại có nền tảng từ công nghệ bên ngoài đã làm dấy lên nhiều tranh luận, không chỉ về mặt kỹ thuật mà còn liên quan đến tính minh bạch trong phát triển AI.

Điều đáng nói hơn cả là vào tháng 6 năm 2025, chính phủ Nhật Bản đã cấm sử dụng DeepSeek trong các bộ và cơ quan chính phủ. Hơn thế nữa, họ cũng khuyến cáo các tập đoàn lớn của Nhật như Toyota, Mitsubishi, SoftBank tránh xa DeepSeek vì các lo ngại về an ninh. Thế nhưng giờ đây, bằng việc quảng bá mô hình AI mới của Rakuten, AI DeepSeek lại có chân trong môi trường công nghệ của Nhật Bản.

Ở góc độ rộng hơn, sự việc phản ánh một thực tế của ngành: trong cuộc đua AI toàn cầu, ranh giới giữa “tự phát triển” và “kế thừa công nghệ” ngày càng trở nên mờ nhạt. Điều này đặt ra câu hỏi không chỉ về năng lực công nghệ, mà còn về cách các doanh nghiệp định vị và truyền thông sản phẩm của mình trong một hệ sinh thái ngày càng phụ thuộc vào mã nguồn mở.

Nguyễn Hải